>> Задачи для поступления >> Задачи весна 2023

Задача 1. Root-Polynomial Color Correction

Предлагается разобраться в содержании работы ‘Color Correction Using Root-Polynomial Regression’ Finlayson et al. doi:10.1109/tip.2015.2405336

Вопросы

-

Зачем решать задачу перехода из пространства камеры в пространство стандартного наблюдателя? Почему это различные пространства?

-

В чем основная сложность задачи перехода из одного цветового пространства в другое? Что такое метамеризм? Что такое условие Лютера?

-

В чем заключаются недостатки LCC и PCC?

-

В чем состоит идея нового метода color correction?

-

Подсчитать суммарное число признаков для полиномиальной коррекции (PCC) степени n

-

***** Подсчитать суммарное число признаков для RPCC степени n

Будет преимуществом, если студент продемонстрирует работу RPCC. Предлагается следующий набор задач:

-

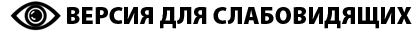

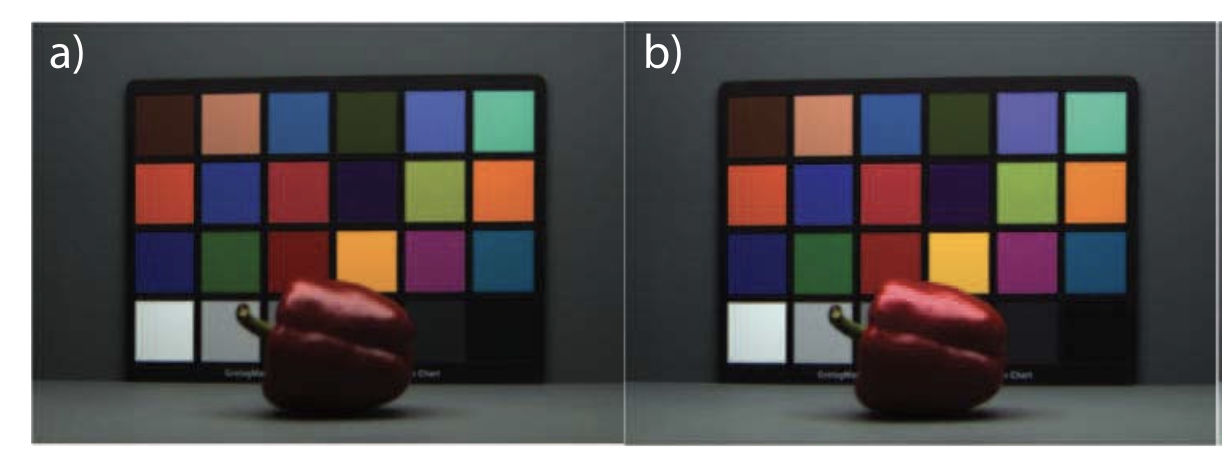

Смоделировать колорчекер в пространстве камеры и в пространстве CIE XYZ

-

Обучить по схеме leave-one-out и оценить качество RPCC по угловой метрике

-

*Сгенерировать гиперспектральное изображение в пространстве камеры и в пространстве CIE XYZ (контрольный вопрос - что такое гиперспектральное изображение?)

-

*Применить модель к сгенерированному пространстве камеры изображению

-

*Посчитать угловую ошибку между сгенерированным в CIE XYZ и преобразованным моделью изображениями

В карточку задачи приложить файл с чувствительностями canon 600D, стандартного наблюдателя, колорчекера и ссылку на датасет Ли, из которого предлагается взять 1-2 изображения.

Любые вопросы и активность по задаче категорически приветствуются, пишите по адресу: https://t.me/shutova_alina

Задача 2. Алгоритм А+

Предлагается разобраться с устройством алгоритма спектральной реконструкции «А+», описанного в статье “In Defense of Shallow Learned Spectral Reconstruction from RGB Images” (DOI: 10.1109/ICCVW.2017.63). Экспериментальную часть разбирать не требуется, однако для ответов на вопросы понадобится заглянуть в другие ссылаемые статьи.

Вопросы

-

Что такое спектральная реконструкция?

-

Что такое метамеризм? Не делает ли он спектральную реконструкцию невозможной?

-

Как спектр видимого излучения представляют в виде вектора?

-

Имеем обученный алгоритм А+. Пусть r — спектр, восстановленный им по цветовому отклику c, k — положительное число. Какой спектр будет восстановлен по отклику kс?

-

Опишите полностью алгоритм А+ (этапы тренировки и реконструкции). В детали устройства алгоритмов K-SVD и OMP можно не углубляться, но нужно рассказать, какую задачу они решают.

-

В статье и ссылках упоминаются и другие методы спектральной реконструкции. В чём выигрывает и проигрывает А+?

Бонусы

-

Напишите A+ на языке Python. В гугл-папке лежат файлы train_radiances.npz и test_radiances.npz — тренировочные и тестовые спектры соответственно. Для тренировочного набора при помощи K-SVD уже сгенерирован «словарь» (терминология статьи) — он сохранён в dictionary.npy. Желательно оформить код в виде класса с методами fit и predict для тренировки и реконструкции соответственно.

-

Докажите (или опровергните контрпримером) тождество

(ATA + λI)-1AT=AT(AAT + λI)-1,

где λ — вещественное число, A — матрица, причём такие, что и левое, и правое выражения имеют смысл.

Любые вопросы можно задавать по электронной почте cromtus@yandex.ru.

Задача 3. Алгоритм дебайеринга Менона

Предлагается статья с описанием алгоритма демозаикинга: Demosaicing With Directional Filtering and a posteriori Decision. Необходимо, изучив ее и сделать доклад по этой работе, ответив на нижеперечисленные вопросы.

Вопросы

-

Какова ценность алгоритма? Каковы его преимущества (недостатки)?

-

Каковы основные шаги работы алгоритма и что в них происходит?

-

Какую роль в формировании конечного изображения играют градиенты?

-

Что делает алгоритм принятия решения?

-

В чем разница обработки зеленого, красного, синего сигналов?

Большим преимуществом будет, если вы сможете:

-

Имплементировать алгоритм, описаный в статье на любом языке программирования. (В случае python допускается использования numpy, imageio).

-

Имплементировать алгоритм с поддержкой векторных операций \ многопоточности.

Любые вопросы и активность по задаче категорически приветствуются, пишите по адресу: perevozchikov.gp@phystech.edu с темой письма “Cобеседование ИППИ”.

Удачи!

Задача 4. ProLab

Предлагается изучить работу Коноваленко и соавторов [1] о перцептивно равномерной системе цветовых координат ProLab.

Необходимо разобраться со следующими вопросами:

-

Как вычисляют координаты цветов?

-

Какие системы цветовых координат являются линейными?

-

Какими свойствами обладает проективное преобразование?

-

Что такое психофизическая равномерность?

-

Что такое STRESS?

-

Что такое гетероскедастичность шума?

[1] Konovalenko I. A. et al. ProLab: a perceptually uniform projective color coordinate system //IEEE Access. – 2021. – Т. 9. – С. 133023-133042.

Вопросы по задаче: basova@visillect.com с темой письма “Cобеседование ИППИ”. Удачи!

Задача 5. Chromatic adaptation transform

Предлагается изучить работу “Some concerns regarding the CAT16 chromatic adaptation transform” [1].

Пояснение к термину, определение которого в статье [1] не приводится: Corresponding color – это пара цветов и источников такие, что цвет 1 под источником 1 воспринимается как цвет 2 под источником 2.

Необходимо разобраться со следующими вопросами:

-

Что такое хроматическая адаптация?

-

Что такое модель фон Криса?

-

Чем отличаются одноступенчатые и двухступенчатые модели CAT?

-

Какие математические проблемы возникают в модели CAT16?

[1] Smet K. A. G., Ma S. Some concerns regarding the CAT16 chromatic adaptation transform //Color Research & Application. – 2020. – Т. 45. – №. 1. – С. 172-177.

Вопросы по задаче: basova@visillect.com с темой письма "Собеседование ИППИ”. Удачи!

Задача 6. Оценка альбедо освещенной сцены

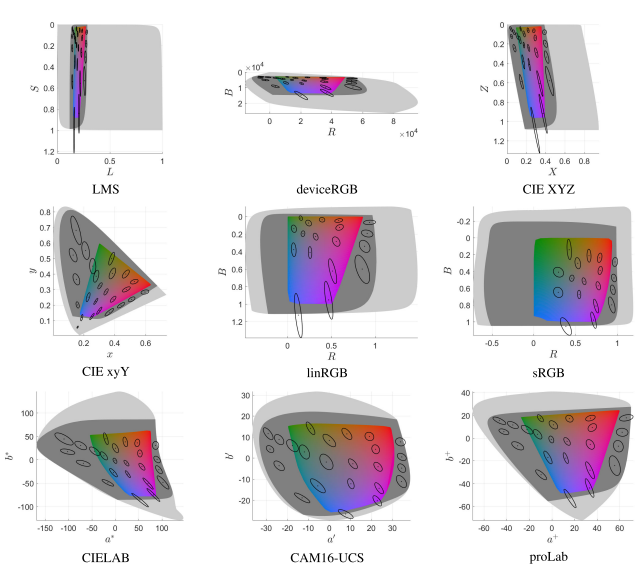

Пусть дана плоская сцена, освещенная точечным источником света. С помощью камеры по законам плоской центральной проекции получено изображение сцены. Источник света не попадает в поле обзора камеры. Яркость каждой точки изображения зависит от освещенности соответствующей точки сцены и её светлоты (альбедо) по закону отражения ламбертовой (идеально матовой) поверхности: B = E * Ф , E = (I * cos φ) / r^2, где B -- видимая яркость точки изображения, E -- освещённость точки сцены, Ф -- её альбедо, I -- излучение источника, φ -- угол между нормалью к плоскости сцены и направлением из точки сцены на источник, а r -- расстояние от точки сцены до источника. Рассмотрим плоскую сцену-квадрат типа мондриан, представляющую собой квадратную мозаику 3х3. Каждый квадрат (элемент мозаики) равномерно ахроматично окрашен (имеет нулевую цветность) и имеет резкие границы с соседями. Светлота каждого квадрата задаётся случайной величиной из нормального распределения. Сцена освещена точечным источником, расположенным для определенности на неизвестной высоте над одной из угловых точек сцены. Камера расположена точно по центру сцены (ее позиция по высоте и фокусное расстояние в этой задаче не важны).

Требуется:

-

Зная положение источника освещения (над каким из углов сцены он расположен), его высоту и светлоты 9 квадратов, рассчитать изображение сцены, получаемое камерой.

-

По единственному изображению освещенной сцены определить положение источника света и альбедо всех девяти квадратов. Сцена занимает всю площадь изображения. Местоположение границ между квадратами считать известным.

Вопросы по задаче: bocharov@iitp.ru с темой письма: “Собеседование ИППИ”. Удачи!

Задача 7. Ошибки в разметках

В задачах машинного обучения данные, а именно качество разметки, играет основную роль в получении точных моделей, корректно решающих поставленную перед ними задачу. Зачастую, данные берутся из открытых источников вместе с готовой разметкой, или отдаются на разметку разметчикам на сторонних платформах. В первом случае невозможно гарантировать безошибочность меток, во втором случае всегда можно ожидать погрешности из-за человеческого фактора.

Покажите, как в эксперименте может проявляться негативное влияние некачественных меток, и предложите варианты решения таких проблем / пути нивелирования негативного влияния.

Примеры источника по теме:

https://labelerrors.com/

Приветствуется активная коммуникация и обсуждение идей с автором задач при подготовке ответа.

Вопросы по задаче:

t.me/vsamokhin

valentin.samokhin@ira-labs.com

Задача 8. Важность Skip connections в U-Net-подобных архитектурах

Стандартной архитектурой в задачах сегментации, особенно в приложении к медицинским задачам, является архитектура U-Net. В рамках задачи предлагается провести сравнительный анализ важности пробросов (a.k.a skip-connections) в U-Net.

Вопросы

1. Что такое UNet, FPN, почему они широко применяются в задачах сегментации?

2. Эксперимент с обучением неглубокого UNet

3. Эксперимент с обучением неглубокого UNet без skip-connections

4. Эксперимент с обучением более глубокого UNet

5. Эксперимент с обучением более глубокого UNet без skip-connections

6. Сравнение полученных результатов и выводы

Источники

https://lmb.informatik.uni-freiburg.de/people/ronneber/u-net/

https://paperswithcode.com/method/fpn

Для получения набора данных и обсуждения решения писать автору задачи: max@ira-labs.com

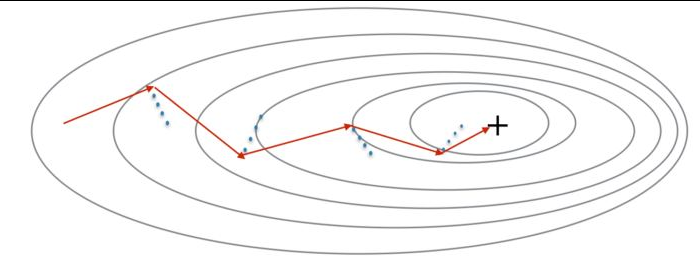

Задача 9. Влияние момента в алгоритмах оптимизации

Решение задач оптимизации, как правило, происходит с помощью градиентных методов. Для обучения глубоких нейронных сетей на практике используют продвинутые реализации алгоритма градиентного спуска, учитывающие момент. Студенту предлагается изучить и рассказать, почему на практике использование момента при оптимизации положительно влияет на нахождение решения оптимизационной задачи.

Источник

https://distill.pub/2017/momentum/

Для обсуждения решения писать автору задачи: max@ira-labs.com

Задача 10. Быстрые алгоритмы цифровой компенсации нелинейных искажений сигнала в волоконно-оптической линии связи

Предлагается изучить работу, посвященную быстрым и сверхбыстрым алгоритмам цифровой компенсации нелинейных искажений в волоконно-оптической линии связи на основе метода обратной задачи рассеяния.

Вопросы

- В чем состоит алгоритм решения линейного уравнения Шредингера и какова его временная сложность?

- Каковы основные шаги метода обратной задачи рассеяния для нелинейного уравнения Шредингера.

- В чем заключается схема Абловица-Ладика аппроксимации системы уравнений Захарова-Шабата?

- В чем заключается прямой и обратный Layer Peeling метод? Какова временная сложность стандартного Layer Peeling метода? Каким образом достигается его ускорение, какова временная сложность сверхбыстрого Layer Peeling метода?

Знания доказательств теорем не требуется.

Задача предназначена для студентов, интересующихся быстрыми алгоритмами в технике связи и возможностью их разработки для реальных проектов.

Вопросы по задаче delitsyn@mail.ru с темой письма “Собеседование ИППИ”.

Задача 11. Self-supervised подход для малых данных

Предлагается исследовать возможность обучения разумных представлений в условиях наличия ограниченных выборок данных и как полученные в результате исследования выводы будут совпадать с выводам в стандартном сценарии, когда данных для обучения много.

В качестве базового алгоритма для построения self-supervised представлений возьмите BYOL [1] или Barlow Twins [2]. В качестве выборок для обучения представлений возьмите CIFAR-10 или CIFAR-100, тестирования - MNIST, FashionMNIST, waterbirds.

Вопросы

-

Что такое self-supervised подход?

-

Как он работает в рамках BYOL или Barlow Twins алгоритма?

-

Как верифицировать адекватность обученных представлений?

-

Насколько сделанные в статьях выводы верны для данных малого размера? Как правильно поставить эксперимент в таком случае?

Вопросы по задаче можно задавать Владимиру Жолобову в телеграм @VlaDreamer

[1] Grill, Jean-Bastien, et al. "Bootstrap your own latent-a new approach to self-supervised learning." Advances in neural information processing systems 33 (2020): 21271-21284.

[2] Zbontar, Jure, et al. "Barlow twins: Self-supervised learning via redundancy reduction." International Conference on Machine Learning. PMLR, 2021.

Задача 12. Гауссовские процессы для прогнозирования временных рядов

Регрессия на основе гауссовских процессов - мощный инструмент, который позволяет решать многие задачи, в том числе задачу прогнозирования временных рядов [1]. В проекте предлагается исследовать, насколько эффективне подход, предложенный в этой статье по сравнению со стандартным подходом и линейным моделями (ARIMA).

Вопросы

-

Что такое регрессия на основе гауссовских процессов

-

Что такое приближенный Байесовский вывод

-

Как эти два инструмента используются для прогнозирования временных рядов

-

Хорошо ли работает предложенный подход для вашего временного ряда? Как она работает по сравнению с базовыми методами (ARIMA, авторегрессия)?

Вопросы по задаче можно задаватьЛеониду Ерлыгину в телеграм @icekingoo

[1] Girard, Agathe, et al. "Gaussian process priors with uncertain inputs application to multiple-step ahead time series forecasting." Advances in neural information processing systems 15 (2002).

Задача 13. MMD score для подсчета расстояний между распределениями

Рассмотрим MMD score для того, чтобы считать расстояния между распределениями по выборкам между этими распределениями. Определение в обычном пространстве и RKHS дано по ссылке.

Также в статье [1] рассматривается использование этой статистики для решения задачи определения разладки. Нужно реализовать этот алгоритм и протестировать его на данных из пакета rupture в python или сгенерированных искусственных данных.

Вопросы

-

Как считают расстояние между эмпирическими распределениями?

-

Что такое MMD score?

-

Как его используют для детектирования разладки?

-

Какие у вас получились результаты вычислительных экспериментов?

Вопросы по задаче можно задавать Александре Базаровой в телеграм @abazarova

[1] Li, Shuang, et al. "M-statistic for kernel change-point detection." Advances in Neural Information Processing Systems 28 (2015).

Задача 14. Аппроксимации метрики Вассерштейна

В машинном обучении зачастую возникает задача сравнения между собой распределений, например, при обучении генеративных нейронных сетей. Для этого используют различные методы, например, KL-дивергенцию, обычную  метрику на предсказанных значениях и т.д. Одной из правильных с математической точки зрения метрик является метрика Вассерштейна или Earth mover"s distance (https://en.wikipedia.org/wiki/Wasserstein_metric). Для случая, когда распределения заданы в метрику на предсказанных значениях и т.д. Одной из правильных с математической точки зрения метрик является метрика Вассерштейна или Earth mover"s distance (https://en.wikipedia.org/wiki/Wasserstein_metric). Для случая, когда распределения заданы в  , её можно посчитать аналитически (см. ссылку выше). Однако для бо́льших размерностей это невозможно, поэтому представляют интерес аппроксимации этой метрики. Таковыми являются, например, Sliced Wasserstein distance и Sinkhorn distance. Детали можно найти в обзорной статье https://www.ncbi.nlm.nih.gov/pmc/articles/PMC6024256/pdf/nihms915458.pdf и в статьях про отдельные методы (https://hal.science/hal-00881872/document, https://proceedings.neurips.cc/paper/2013/file/af21d0c97db2e27e13572cbf59eb343d-Paper.pdf). , её можно посчитать аналитически (см. ссылку выше). Однако для бо́льших размерностей это невозможно, поэтому представляют интерес аппроксимации этой метрики. Таковыми являются, например, Sliced Wasserstein distance и Sinkhorn distance. Детали можно найти в обзорной статье https://www.ncbi.nlm.nih.gov/pmc/articles/PMC6024256/pdf/nihms915458.pdf и в статьях про отдельные методы (https://hal.science/hal-00881872/document, https://proceedings.neurips.cc/paper/2013/file/af21d0c97db2e27e13572cbf59eb343d-Paper.pdf).

Вашей задачей будет разобраться, как устроено каждое из этих двух приближений, и реализовать свою версию. А именно:

-

Разобраться в деталях, что такое метрика Вассерштейна и как она работает в дискретном случае.

-

Разобраться кратко, как для случая дискретных распределений её можно считать точно. Понимать временную сложность методов для этого.

-

Изучить 2 предложенные аппроксимации метрики (Sliced Wasserstein / Sinkhorn). Понять, за счёт чего они работают, какие у них минусы, где находятся границы применимости.

-

Реализовать одну из них на выбор.

-

Ваша реализация должна работать с ограниченными 2D гистограммами (вход — 2d array, в каждой ячейке которого записана её вероятность)

-

( ( -Wasserstein, прочитайте, что это такое в источниках выше) -Wasserstein, прочитайте, что это такое в источниках выше)

-

Она должна быть вычислительно эффективной. Ожидается, что её можно будет использовать для обучения нейросети с гистограммами 128x128

-

В идеале она должна быть написана на Python с использованием фреймворка PyTorch.

-

Для проверки реализуйте также тесты. Например, очевидно, что при смещении обеих гистограмм метрика меняться не должна. Можете ли вы придумать другие тесты? Можете ли вы также придумать примеры, для которых можно аналитически вычислить значение метрики Вассерштейна? Если да, попробуйте реализовать тесты и для них тоже.

-

При реализации не запрещается пользоваться готовыми решениями (обратите внимание на https://www.kernel-operations.io/geomloss/api/pytorch-api.html), в том числе просто приспособить их интерфейсы к конкретной формулировке задачи. Однако если вы пользуетесь готовым инструментом, необходимо его тщательно протестировать и уметь хорошо отвечать на вопросы про его устройство.

Бонусы

Исследуйте, какие ещё бывают аппроксимации Вассерштейна.

Какие ещё бывают метрики на вероятностных распределениях? Сделайте краткий обзор.

|